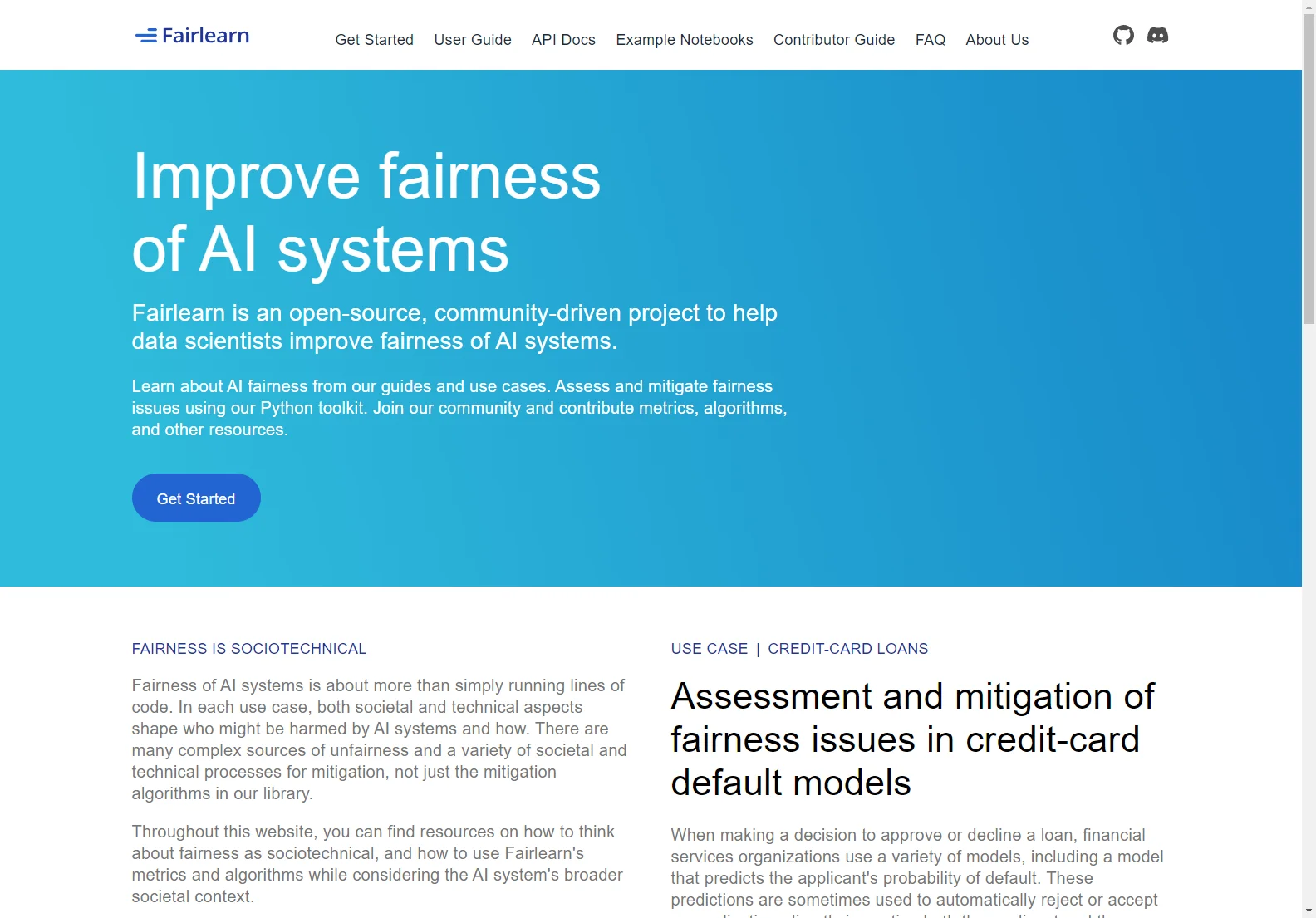

Fairlearn : Améliorer l'équité des systèmes d'IA

Fairlearn est un projet open-source et dirigé par la communauté, visant à aider les data scientists à améliorer l'équité des systèmes d'IA. Sur ce site, vous trouverez des guides et des cas d'utilisation pour comprendre l'équité en IA. Vous pouvez évaluer et atténuer les problèmes d'équité en utilisant notre boîte à outils Python.

L'équité des systèmes d'IA englobe plus que l'exécution de lignes de code. Chaque cas d'utilisation est influencé par des aspects sociétaux et techniques, déterminant qui pourrait être lésé par les systèmes d'IA et comment. Il existe de nombreuses sources d'inéquité complexes et diverses procédures sociétales et techniques pour atténuer ces problèmes, pas seulement les algorithmes de mitigation de notre bibliothèque.

Par exemple, dans le cas des prêts sur cartes de crédit, les organisations financières utilisent des modèles pour décider d'approuver ou de refuser un prêt. Fairlearn permet d'évaluer comment différents groupes, définis en fonction de leur sexe, sont affectés et comment les disparités observées peuvent être atténuées.

Pour commencer avec Fairlearn, installez le package. Consultez le guide d'utilisateur et d'autres ressources pour comprendre ce que l'équité signifie pour votre cas d'utilisation. Si vous rencontrez des problèmes, contactez-nous sur Discord.

La communauté Fairlearn est composée de contributeurs open-source, de praticiens de la data science et d'enthousiastes de l'IA responsable de nombreuses disciplines et emplacements. Rejoignez la conversation, posez des questions d'utilisation, découvrez les dernières mises à jour et comment vous pouvez vous impliquer.