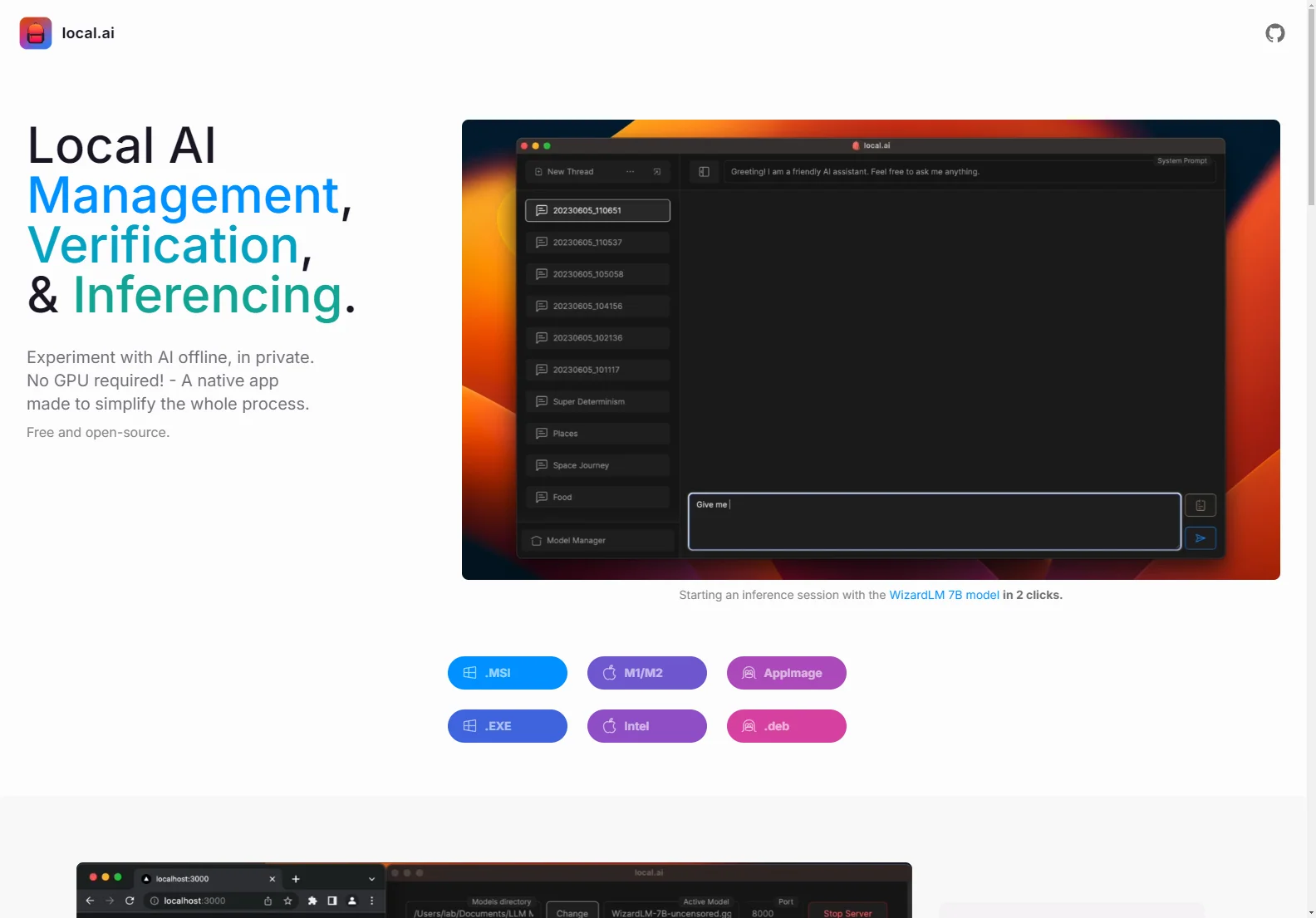

local.ai: O Espaço de IA Local

local.ai é uma solução inovadora que traz a facilidade da gestão, verificação e inferência de IA para os usuários. Com a capacidade de experimentar a IA offline e de forma privada, sem a necessidade de uma GPU, este aplicativo oferece uma experiência única.

Core Features

- O aplicativo possui um backend em Rust, tornando-o eficiente em termos de memória e compacto. Ele ocupa menos de 10MB em sistemas Mac M2, Windows e Linux.deb.

- Oferece inferência de CPU, adaptando-se às threads disponíveis, e possui quantização GGML q4, 5.1, 8, f16.

- Permite a verificação de digestos para garantir a integridade dos modelos baixados, com recursos de cálculo BLAKE3 e SHA256.

Basic Usage

- Iniciar uma sessão de inferência com o modelo WizardLM 7B é fácil, com apenas dois cliques.

- Os usuários podem gerenciar seus modelos de IA em um local centralizado, com recursos como downloader contínuo e classificação baseada no uso.

- Além disso, o local.ai permite iniciar um servidor de streaming local para inferência de IA com apenas dois cliques.

Com recursos futuros como inferência de GPU, pesquisa e recomendação de modelos, e mais, local.ai está pronto para atender às necessidades crescentes dos usuários de IA.