InCoder: Um Modelo Gerativo para Preenchimento e Síntese de Código

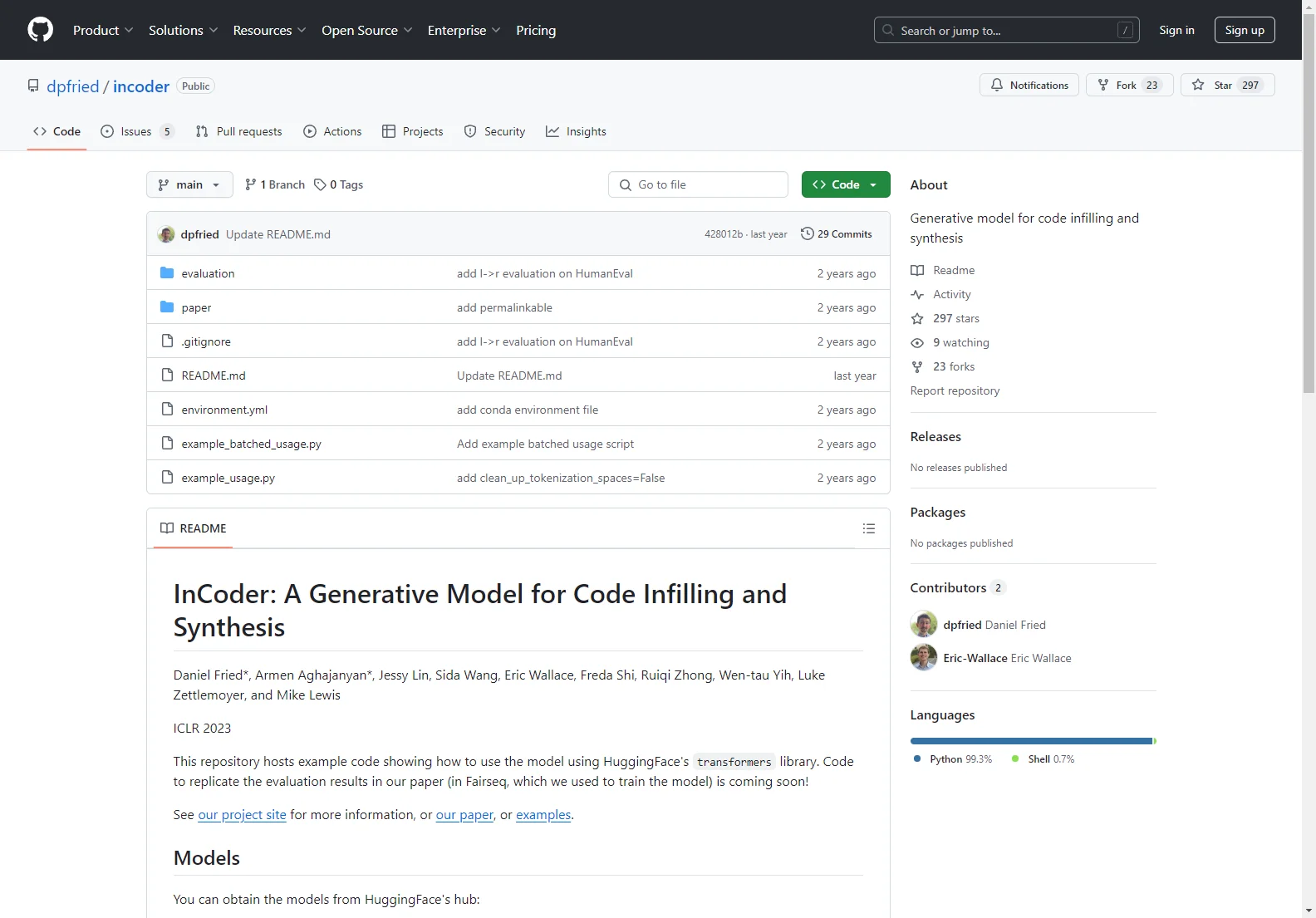

O repositório dpfried/incoder apresenta um modelo gerativo para o preenchimento e síntese de código. Ele utiliza a biblioteca transformers do HuggingFace. O modelo foi treinado com certas especificações, como o uso de um tokenizador personalizado.

Recursos Principais:

- Modelos disponíveis no HuggingFace's hub: facebook/incoder-6B (6.7B parâmetros) e facebook/incoder-1B (1.3B parâmetros).

- Requisitos: pytorch, tokenizers e transformers. A versão mínima exigida dos tokenizers é 0.12.1.

Uso:

- Exemplo de uso da capacidade de preenchimento do modelo está em example_usage.py. Definindo BIG_MODEL = True, utiliza-se o modelo de 6.7B parâmetros; caso contrário, usa-se o de 1.3B.

- Para um exemplo de geração em lote, consulte example_batched_usage.py.

Documentação:

- A pesquisa detalhada sobre o método, dados de treinamento, modelos e resultados experimentais está disponível no paper.

O dpfried/incoder oferece uma solução interessante para as tarefas de preenchimento e síntese de código.