DreamFusion: Transformando Texto em 3D com Difusão 2D

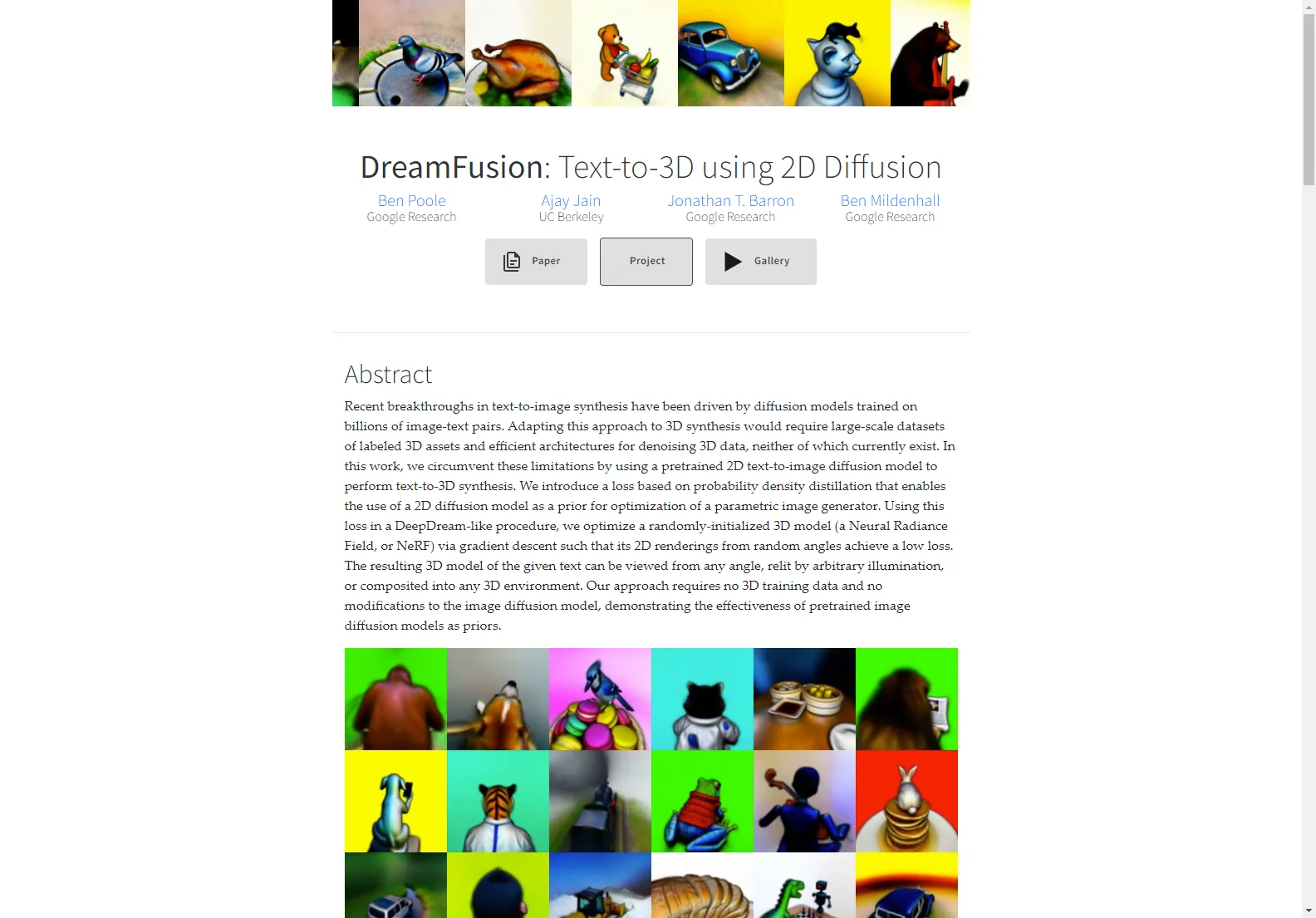

DreamFusion é uma inovação no campo da síntese 3D. Ele utiliza um modelo de difusão 2D pré-treinado para realizar a síntese de texto para 3D, contornando as limitações de dados e arquiteturas 3D.

A ferramenta introduz uma perda baseada na destilação de densidade de probabilidade, permitindo a otimização de um gerador de imagem paramétrico. Através de um procedimento semelhante ao DeepDream, um modelo 3D inicializado aleatoriamente (um Neural Radiance Field ou NeRF) é otimizado por meio de descida de gradiente, de modo que suas renderizações 2D de ângulos aleatórios obtenham uma baixa perda.

Com o DreamFusion, o modelo 3D resultante do texto fornecido pode ser visto de qualquer ângulo, iluminado arbitrariamente ou composto em qualquer ambiente 3D. Além disso, os modelos NeRF gerados podem ser exportados para malhas usando o algoritmo marching cubes, facilitando a integração em renderizadores 3D ou softwares de modelagem.

A ferramenta utiliza um modelo gerativo de texto para imagem chamado Imagen para otimizar uma cena 3D e propõe o Score Distillation Sampling (SDS), uma maneira de gerar amostras de um modelo de difusão otimizando uma função de perda. O DreamFusion adiciona regularizadores e estratégias de otimização adicionais para melhorar a geometria, resultando em NeRFs treinados coerentes, com normais, geometria de superfície e profundidade de alta qualidade, e que são ilumináveis com um modelo de sombreamento Lambertiano.