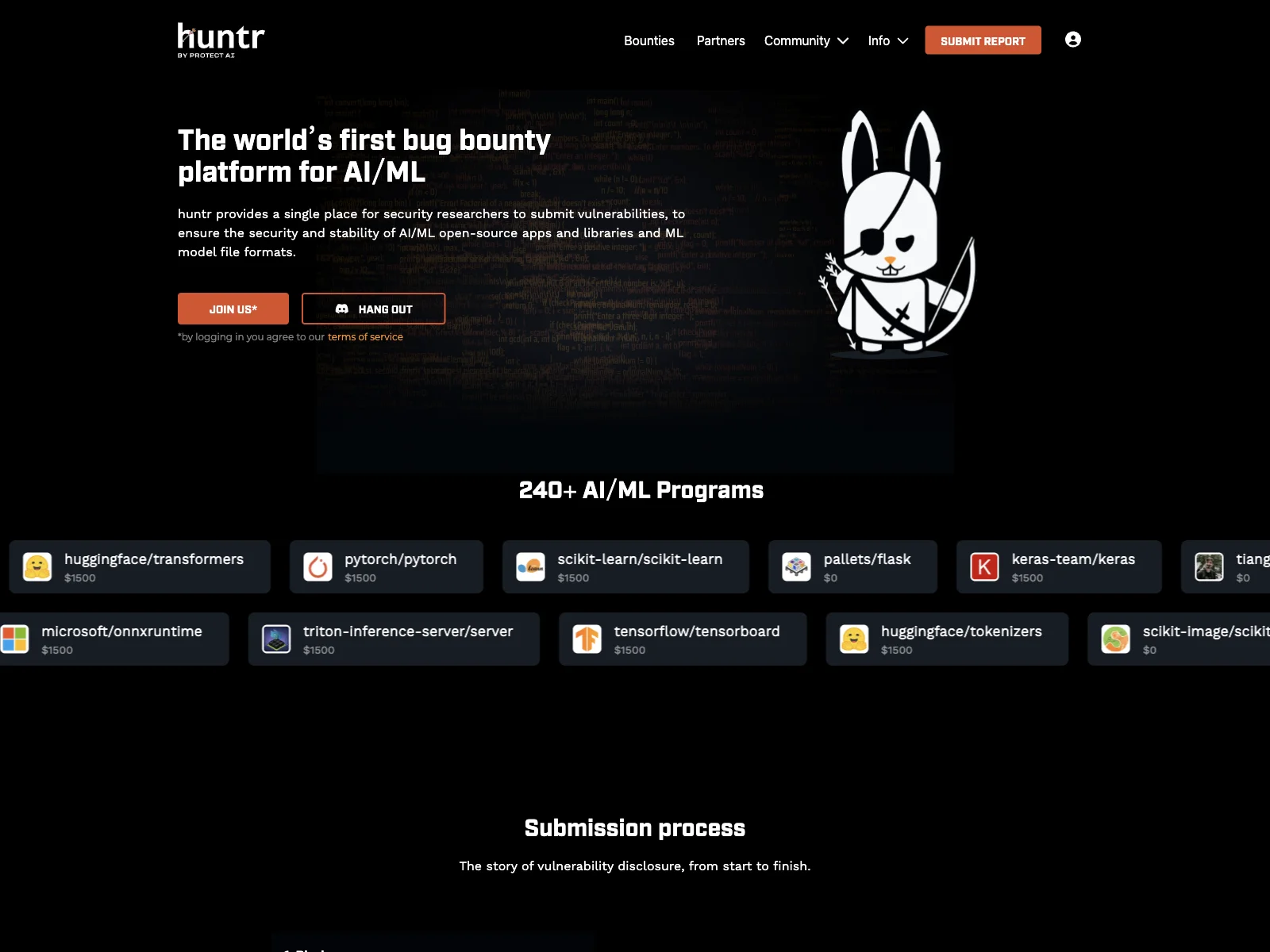

huntr : La première plateforme de bug bounty pour l'IA/ML

huntr est une initiative innovante dans le domaine de la sécurité de l'IA et du Machine Learning. Cette plateforme offre un espace unique aux chercheurs en sécurité pour soumettre des vulnérabilités, contribuant ainsi à assurer la sécurité et la stabilité des applications et bibliothèques open source d'IA/ML, ainsi que des formats de fichiers de modèles ML.

Fonctionnement de la soumission :

- Le chercheur trouve et soumet une vulnérabilité via un formulaire sécurisé.

- Nous contactons le responsable et le relançons toutes les 7 jours. Le responsable a 31 jours pour répondre au rapport. En cas d'absence de réponse, nous résoudons manuellement les rapports hautement critiques et critiques dans les 14 jours.

- Si le rapport est jugé valide par le responsable ou huntr, le chercheur reçoit une prime. Les rapports open source obtiennent également un CVE et une prime de correction peut être attribuée au responsable pour la correction de la vulnérabilité et l'intégration du correctif. Cependant, la possibilité de soumettre un correctif et de demander la prime de correction n'est pas encore prise en charge.

- Tous les rapports de vulnérabilités open source sont rendus publics au 90e jour, mais les responsables peuvent demander une extension si nécessaire. Les rapports marqués comme informatifs ou invalides sont rendus publics immédiatement. Les rapports relatifs aux formats de fichiers de modèles ne sont pas divulgués publiquement.

huntr soutient l'industrie de l'IA en renforçant la sécurité et en favorisant une meilleure gestion des vulnérabilités, contribuant ainsi à un avenir plus sûr pour l'IA et le Machine Learning.